Применение горячей воды для энергоэффективного охлаждения суперкомпьютера

Система водяного охлаждения от IBM позволяет сократить энергопотребление суперкомпьютера Leibniz SuperMUC на 40%.

При создании суперкомпьютерных систем в расчет берется не только фактор производительности. Сокращение энергопотребления является одной из наиболее сложных технических проблем на пути к созданию мощных и быстрых суперкомпьютеров.

Новый суперкомпьютер SuperMUC

Представители Leibniz Supercomputing Centre (LRZ) сообщили, что их новый суперкомпьютер SuperMUC (MUC в названии соответствует коду расположенного неподалеку Мюнхенского аэропорта), построенный в сотрудничестве с IBM, потребляет на 40% меньше энергии, чем его аналоги. Существенная экономия энергии достигается за счет использования технологии водяного охлаждения, которую IBM применяет с целью создания компьютерных систем с высокой плотностью размещения оборудования.

Системы водяного охлаждения применяются для охлаждения активных компонентов компьютера (процессор, память) за счет циркуляции воды в контуре. Подобные системы зачастую требуют предварительного охлаждения используемой воды, сообщают представители Leibniz Supercomputing Centre. Однако, SuperMUC может работать при температуре воды до 40°С. Это означает, что охлаждение отработанной воды может выполняться с помощью окружающего воздуха или посредством теплообмена. Установка насосного холодильного оборудования не требуется.

Установленная в LRZ система направляет нагретую суперкомпьютером воду в теплообменник. В холодное время года вода будет использоваться для отопления здания. Согласно прогнозам, это позволит достигнуть ежегодной экономии порядка 1млн евро. SuperMUC не только энергоэффективен, он обладает высочайшей производительностью: оснащенный более чем 150 000 процессоров, расположенных в 9400 вычислительных узлах, и более чем 300ТБ оперативной памяти, SuperMUC является самым мощным суперкомпьютером в Европе с пиковой производительностью 3 петафлопс, или 10 000 000 000 000 000 операций с плавающей точкой в секунду.

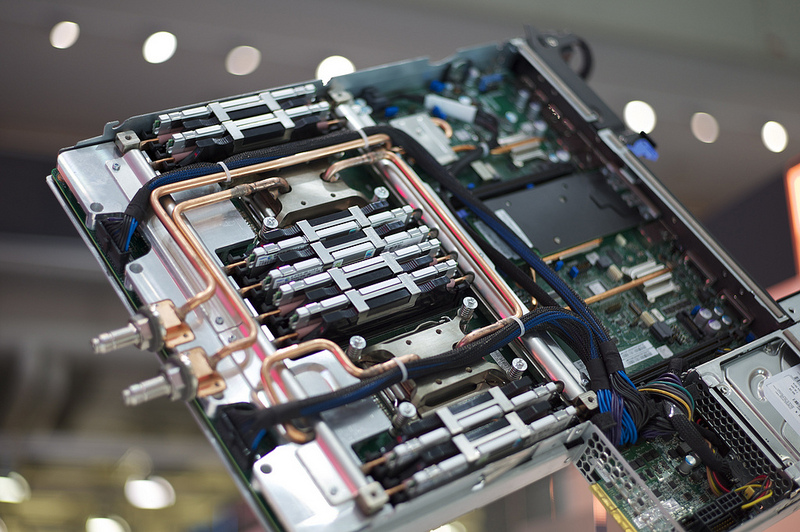

Технология компьютерного охлаждения под названием Aquasar была разработана в исследовательской лаборатории IBM в Цюрихе. Небольшие трубы, названные микроканалами, доставляют воду непосредственно к серверным процессорам. После охлаждения вода рециркулируется для повторного отвода тепла.

Серверная система охлаждения x iDataPlex dx360 M4 от IBM

Исследования в области водяного охлаждения ведутся уже много лет, однако, в типичном ЦОД или суперкомпьютерном центре для охлаждения серверов и прочего оборудования применяется воздушное охлаждение. На крупных объектах на систему охлаждения приходится до 50% общего энергопотребления.

Использование энергоэффективной компьютерной архитектуры является важным в стране, заботящейся об экологии, каковой является Германия, утверждает Герберт Хубер, сотрудник Leibniz Supercomputing Centre. «В Германии много внимания уделяется зеленым технологиям, так что снижение энергопотребления является крайне важным аспектом», - заявил Хубер.

Технологии управления энергопотреблением и пиковой производительностью приобретают все большую значимость по мере того, как происходит рост плотности размещения вычислительных систем. За счет энергоэффективной конструкции SuperMUC является в 10 раз более компактным и имеет более высокую пиковую производительность, чем аналогичные системы с воздушным охлаждением, сообщают представители Leibniz Supercomputing Centre.

IBM рассчитывает, что применение горячего водяного охлаждения станет стандартом для суперкомпьютеров будущего, в том числе для трехмерных процессорных архитектур, предполагающих размещение процессоров друг над другом. Исследователи работают над созданием крошечных труб диаметром 50 микрон, которые можно будет располагать между процессорами, сообщают представители IBM Research. Согласно прогнозам IBM, к 2025 году размер суперкомпьютера может уменьшиться до размера типичного настольного ПК образца 2012 года за счет использования водяного охлаждения.

Система водяного охлаждения, установленная на SuperMUC.

Дополнительные материалы

Оставить комментарий